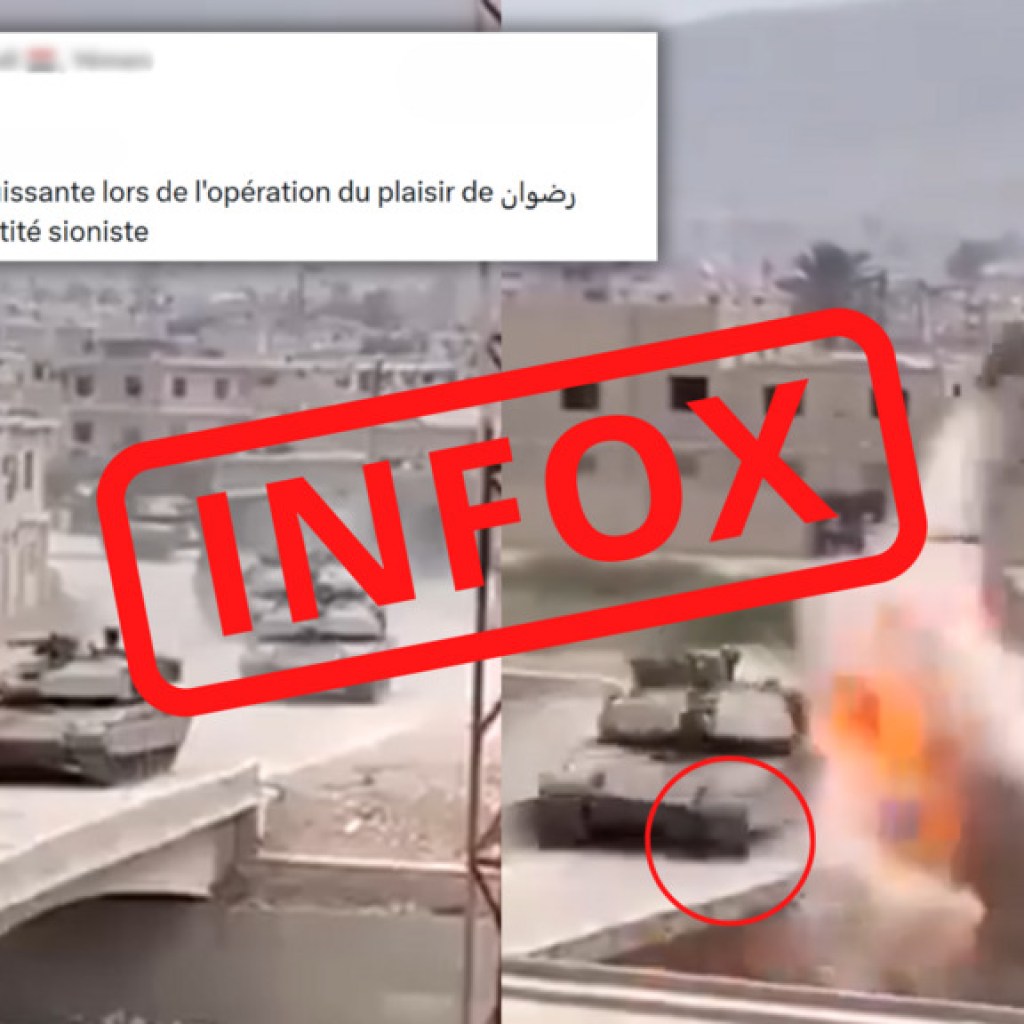

Les images sont impressionnantes. On pense y voir trois chars de combat en train de progresser sur une route bitumée, à la sortie d’un village. Au moment où ils traversent un pont, l’édifice explose, engloutissant les trois engins blindés. Les comptes qui partagent cette vidéo affirment, à tort, qu’elle montre « l’embuscade la plus puissante menée par la Force al-Radwan (unité d’élite du Hezbollah) contre les chars de l’entité sioniste ».

Vérification faite, ce clip, vu près de 5 millions de fois en seulement vingt-quatre heures, n’est pas réel. Il a été entièrement généré par intelligence artificielle.

Incohérences visuelles

Si les images sont très réalistes, elles comportent tout de même plusieurs incohérences visuelles. Le premier char de combat se dresse sans raison apparente au niveau du pont. Malgré l’effet de souffle entraîné par l’explosion, la caméra et la végétation aux alentours ne bougent pas d’un centimètre. Une fois l’édifice en partie détruit, les deux engins blindés ne ralentissent pas : ils semblent se diriger délibérément dans le vide. Enfin, un morceau de béton reste en place malgré la disparition du pont.

L’autre élément à prendre en compte est la durée de la vidéo. Elle dure précisément 15 secondes, soit la durée standard de certains outils de génération de vidéos comme Sora 2, d’Open AI. Cet indicateur permet rapidement de douter de l’authenticité de ce type de contenus.

À lire aussiSora 2: le générateur de vidéos par IA qui a tout pour devenir une usine à infox

Pollution de l’espace informationnel

Ces vidéos synthétiques ultra-réalistes inondent les réseaux sociaux dans le cadre de la guerre au Moyen-Orient. Ces fausses informations saturent l’espace numérique et invisibilisent parfois les vraies images filmées par des témoins et des journalistes.